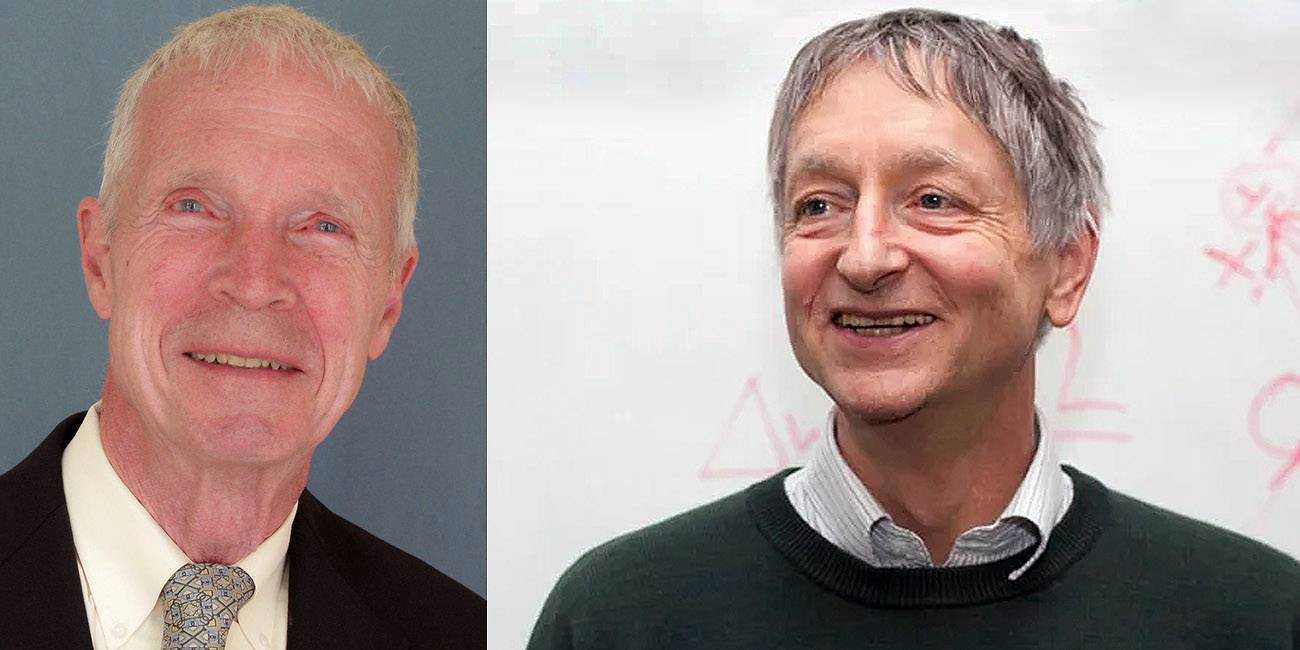

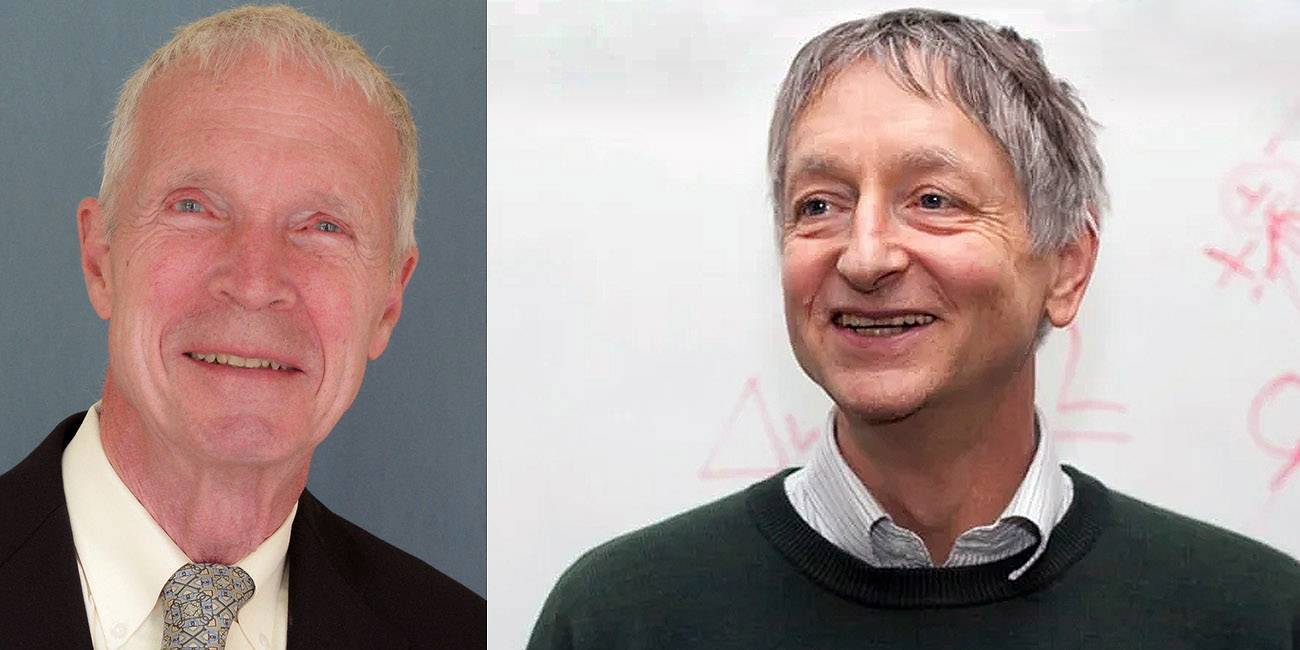

Nobel de Física 2024 para dos pioneros en redes neuronales artificiales

La Real Academia Sueca de las Ciencias ha premiado a los investigadores John Hopfield, de la Universidad de Princeton (EE UU), y Geoffrey Hinton, de la Universidad de Toronto (Canadá), por sus descubrimientos e inventos que permiten el aprendizaje automático con las redes neuronales artificiales.

Los dos Premios Nobel de Física de este año han utilizado herramientas de la física para desarrollar métodos que son la base del potente aprendizaje automático actual, una de las ramas de la inteligencia artificial (IA).

Los dos Nobel de Física de este año han utilizado herramientas de la física para desarrollar métodos que son la base del potente aprendizaje automático actual

La Real Academia Sueca de las Ciencias ha dado a conocer este martes sus nombres: John Hopfield, que creó una memoria asociativa capaz de almacenar y reconstruir imágenes y otros tipos de patrones en los datos, y Geoffrey Hinton, quien inventó un método capaz de encontrar de forma autónoma propiedades en los datos y realizar así tareas como identificar elementos concretos en imágenes.

Se premia a ambos “por descubrimientos e invenciones fundacionales que permiten el aprendizaje automático con redes neuronales artificiales”, según el Comité Nobel de Física. Este campo está revolucionando la ciencia, la ingeniería y la vida cotidiana.

De redes neuronales naturales a artificiales

Cuando hablamos de IA solemos referirnos al aprendizaje automático mediante redes neuronales artificiales. Esta tecnología se inspiró originalmente en la estructura y redes neuronales naturales del cerebro.

Las redes neuronales naturales han inspirado las artificiales. / Johan Jarnestad/The Royal Swedish Academy of Sciences

Las redes neuronales naturales tienen neuronas que envían señales a través del proceso de la sinapsis. Cuando aprendemos cosas, las conexiones entre algunas neuronas se hacen más fuertes, mientras que otras, más débiles.

En una red neuronal artificial, esas neuronas cerebrales están representadas por nodos, que son codificados con valores diferentes. Estos están conectados entre sí y también se influyen mutuamente a través de conexiones (como las sinapsis), que pueden reforzarse o debilitarse.

La red se entrena, por ejemplo, desarrollando conexiones más fuertes entre nodos que tienen valores altos simultáneamente. Los galardonados de este año han realizado importantes trabajos con este tipo de redes neuronales artificiales desde la década de 1980.

El aprendizaje automático ayuda a la clasificación y el análisis de ingentes cantidades de datos. / Johan Jarnestad/The Royal Swedish Academy of Sciences

La red de Hopfield

John Hopfield, de la Universidad de Princeton (EE UU), inventó una red que utiliza un método para guardar y recrear patrones. Podemos imaginar los nodos como píxeles. La llamada red de Hopfield utiliza la física que describe las características de un material debido a su espín atómico, una propiedad que convierte a cada átomo en un pequeño imán.

La red de Hopfield trabaja paso a paso para encontrar la imagen guardada que más se parece a la imperfecta con la que se alimentó

La red en su conjunto se describe de forma equivalente a la energía en un sistema de espín dentro de la física, y se entrena encontrando valores para las conexiones entre los nodos de forma que las imágenes guardadas tengan una energía baja.

Cuando la red de Hopfield recibe una imagen incompleta o distorsionada, recorre metódicamente los nodos y actualiza sus valores para que la energía de la red disminuya. De este modo, la red trabaja paso a paso para encontrar la imagen guardada que más se parece a esa imperfecta.

Hinton usa la máquina de Boltzmann

El profesor Geoffrey Hinton, de la Universidad de Toronto (Canadá), utilizó la red de Hopfield como base para una nueva red que utiliza un método diferente: la máquina de Boltzmann. Esta puede aprender a reconocer elementos característicos en un determinado tipo de datos. Hinton utilizó herramientas de la física estadística, la ciencia de los sistemas construidos a partir de muchos componentes similares.

La máquina de Boltzmann puede utilizarse para clasificar imágenes o crear nuevos ejemplos del tipo de patrón sobre el que se ha entrenado

La máquina se entrena alimentándola con ejemplos que tienen muchas probabilidades de aparecer cuando se pone en marcha. La máquina de Boltzmann puede utilizarse para clasificar imágenes o crear nuevos ejemplos del tipo de patrón sobre el que se ha entrenado. Hinton se ha basado en este trabajo, ayudando a iniciar el explosivo desarrollo actual del aprendizaje automático.

“El trabajo de los dos galardonados ya ha sido de lo más beneficioso. En física utilizamos redes neuronales artificiales en una amplia gama de áreas, como el desarrollo de nuevos materiales con propiedades específicas”, ha destacado Ellen Moons, presidenta del Comité Nobel de Física.

El estadounidense Hopfield nació en 1933 en Chicago, se doctoró en 1958 en la Universidad de Cornell (Nueva York) y ahora es profesor emérito en Princeton. Por su parte, Hinton nació en 1947 en Londres (Reino Unido), se doctoró en 1978 en la Universidad de Edimburgo y, tras trasladarse a Canadá, actualmente ejerce en la Universidad de Toronto.